Comment réduire les hallucinations de l’IA avec ces 6 techniques d’incitation

Principaux enseignements

- Des messages clairs et précis sont essentiels pour réduire l’hallucination de l’IA. Évitez les instructions vagues et fournissez des détails explicites pour éviter les résultats imprévisibles.

- Utilisez l’ancrage ou la technique « selon. » pour attribuer les résultats à une source ou à un point de vue spécifique. Cela permet d’éviter les erreurs factuelles et les préjugés dans le contenu généré par l’IA.

- Utiliser des contraintes et des règles pour façonner les résultats de l’IA en fonction des résultats souhaités. Énoncez explicitement les contraintes ou sous-entendez-les par le biais du contexte ou de la tâche afin d’éviter les résultats inappropriés ou illogiques.

Vous n’obtenez pas la réponse que vous souhaitez d’un modèle d’IA générative ? Vous avez peut-être affaire à une hallucination de l’IA, un problème qui survient lorsque le modèle produit des résultats inexacts ou non pertinents.

Ce problème est dû à différents facteurs, tels que la qualité des données utilisées pour former le modèle, l’absence de contexte ou l’ambiguïté de l’invite. Heureusement, il existe des techniques permettant d’obtenir des résultats plus fiables de la part d’un modèle d’IA.

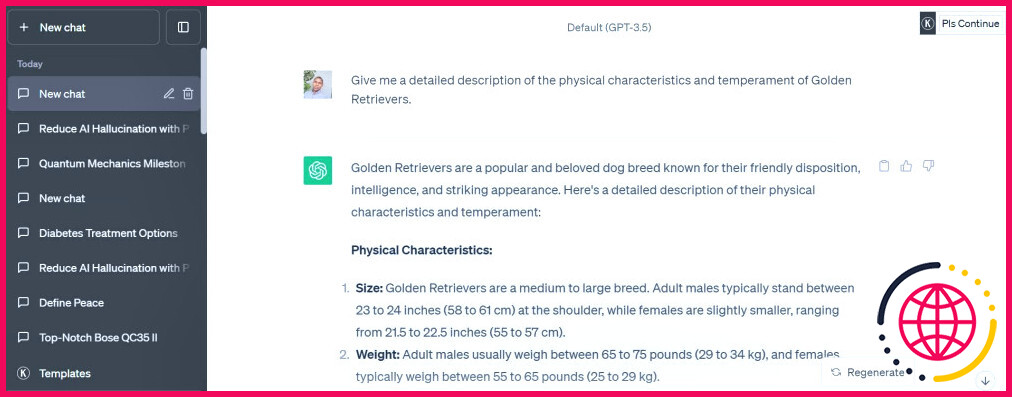

1. Fournir des messages clairs et spécifiques

La première étape pour minimiser les hallucinations de l’IA consiste à créer des invites claires et très spécifiques. Les messages vagues ou ambigus peuvent conduire à des résultats imprévisibles, car les modèles d’IA peuvent tenter d’interpréter l’intention qui se cache derrière le message. Au lieu de cela, soyez explicite dans vos instructions.

Au lieu de demander « Parlez-moi des chiens », vous pourriez demander « Décrivez-moi en détail les caractéristiques physiques et le tempérament des Golden Retrievers ». Affiner votre demande jusqu’à ce qu’elle soit claire est un moyen facile d’éviter les hallucinations de l’IA.

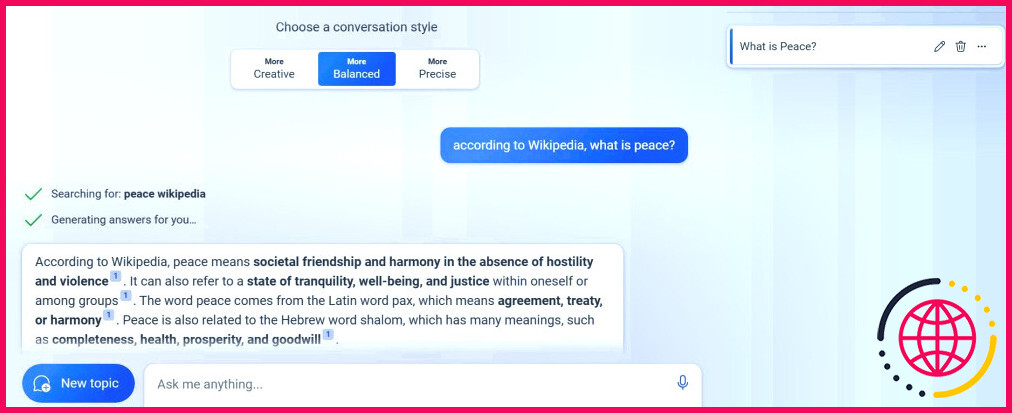

2. Utiliser la mise à la terre ou la technique « Selon. » Technique

L’un des défis liés à l’utilisation des systèmes d’IA est qu’ils peuvent générer des résultats qui sont factuellement incorrects, biaisés ou incompatibles avec vos opinions ou vos valeurs. Cela peut se produire parce que les systèmes d’IA sont formés sur des ensembles de données vastes et diversifiés qui peuvent contenir des erreurs, des opinions ou des contradictions.

Pour éviter cela, vous pouvez utiliser la technique du grounding ou du « selon. », qui consiste à attribuer les résultats à une source ou à un point de vue spécifique. Par exemple, vous pouvez demander au système d’IA d’écrire un fait sur un sujet d’après Wikipedia, Google Scholar ou une source spécifique accessible au public.

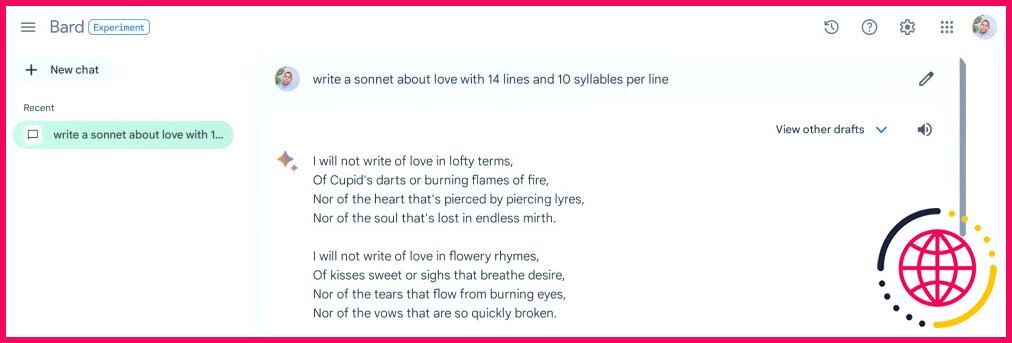

3. Utiliser des contraintes et des règles

Les contraintes et les règles peuvent contribuer à empêcher le système d’IA de produire des résultats inappropriés, incohérents, contradictoires ou illogiques. Elles peuvent également contribuer à façonner et à affiner les résultats en fonction du résultat et de l’objectif souhaités. Les contraintes et les règles peuvent être explicitement énoncées dans l’invite ou implicitement sous-entendues par le contexte ou la tâche.

Supposons que vous souhaitiez utiliser un outil d’IA pour écrire un poème sur l’amour. Au lieu de lui donner une instruction générale comme « écrivez un poème sur l’amour », vous pouvez lui donner une instruction plus contraignante et basée sur des règles comme « écrivez un sonnet sur l’amour avec 14 lignes et 10 syllabes par ligne ».

4. Utiliser une incitation en plusieurs étapes

Parfois, des questions complexes peuvent conduire à des hallucinations de l’IA parce que le modèle tente d’y répondre en une seule étape. Pour y remédier, décomposez vos requêtes en plusieurs étapes.

Par exemple, au lieu de demander « Quel est le traitement le plus efficace contre le diabète ? », vous pouvez demander « Quels sont les traitements courants contre le diabète ? ». Vous pouvez ensuite demander : « Lequel de ces traitements est considéré comme le plus efficace d’après les études médicales ? »

L’interrogation en plusieurs étapes oblige le modèle d’IA à fournir des informations intermédiaires avant de parvenir à une réponse finale, ce qui peut conduire à des réponses plus précises et mieux informées.

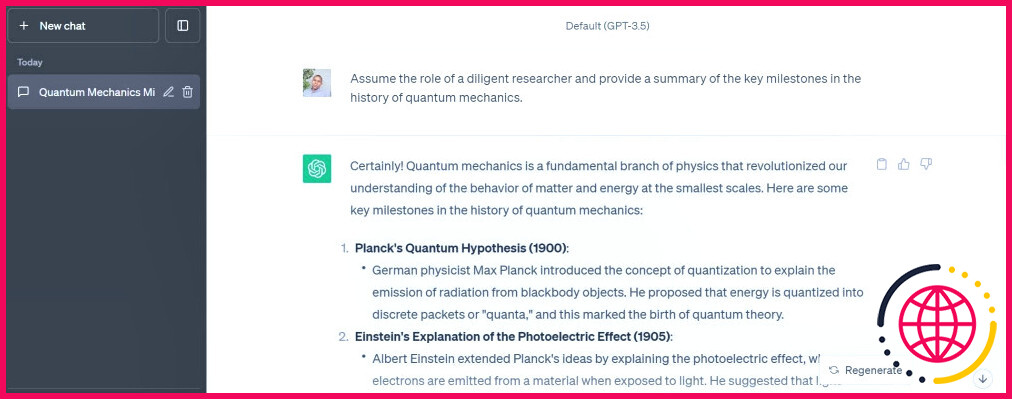

5. Attribuer un rôle à l’IA

Lorsque vous attribuez un rôle spécifique au modèle d’IA dans votre invite, vous clarifiez son objectif et réduisez le risque d’hallucination. Par exemple, au lieu de dire « Parlez-moi de l’histoire de la mécanique quantique », vous pouvez demander à l’IA d’assumer le rôle d’un chercheur diligent et de fournir un résumé des principales étapes de l’histoire de la mécanique quantique.

Ce cadre encourage l’IA à agir comme un chercheur diligent plutôt que comme un conteur spéculatif.

6. Ajouter des informations contextuelles

Ne pas fournir d’informations contextuelles lorsque cela est nécessaire est une erreur à éviter lors de l’utilisation de ChatGPT ou d’autres modèles d’IA. Les informations contextuelles aident le modèle à comprendre le contexte, le domaine ou l’objectif de la tâche et à générer des résultats plus pertinents et plus cohérents. Les informations contextuelles comprennent les mots-clés, les balises, les catégories, les exemples, les références et les sources.

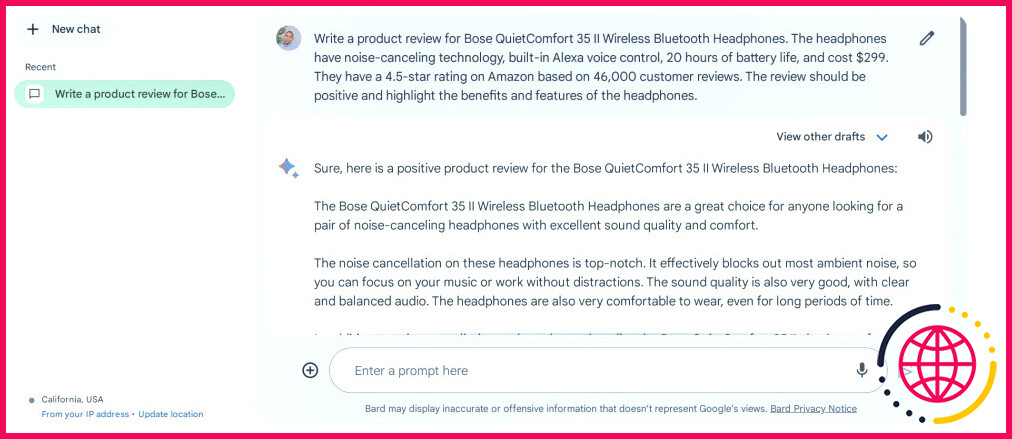

Par exemple, si vous souhaitez générer une évaluation de produit pour une paire d’écouteurs, vous pouvez fournir des informations contextuelles, telles que le nom du produit, la marque, les caractéristiques, le prix, l’évaluation ou les commentaires des clients. Une bonne invite pour cette tâche pourrait ressembler à ceci :

Obtenir de meilleures réponses de l’IA

Il peut être frustrant de ne pas obtenir le retour d’information que vous attendez d’un modèle d’IA. Toutefois, grâce à ces techniques d’incitation, vous pouvez réduire la probabilité d’hallucination de l’IA et obtenir des réponses meilleures et plus fiables de la part de vos systèmes d’IA.

Gardez à l’esprit que ces techniques ne sont pas infaillibles et qu’elles peuvent ne pas fonctionner pour toutes les tâches ou tous les sujets. Vous devez toujours contrôler et vérifier les résultats de l’IA avant de les utiliser à des fins sérieuses.