6 gros problèmes avec le ChatGPT d’OpenAI

ChatGPT est un nouveau chatbot d’IA puissant qui impressionne rapidement, mais de nombreuses personnes ont souligné qu’il présentait de sérieux inconvénients. Demandez-lui ce que vous voulez, et vous recevrez une réponse qui semble avoir été écrite par un humain, qui a acquis ses connaissances et ses compétences rédactionnelles en étant formé sur des quantités massives de données sur Internet.

Cependant, tout comme sur Internet, la frontière entre la vérité et la fantaisie est certainement inconstante, et ChatGPT est coupable de s’être trompé plus d’une fois. Alors que ChatGPT s’apprête à changer notre avenir, voici quelques-unes de nos plus grandes inquiétudes.

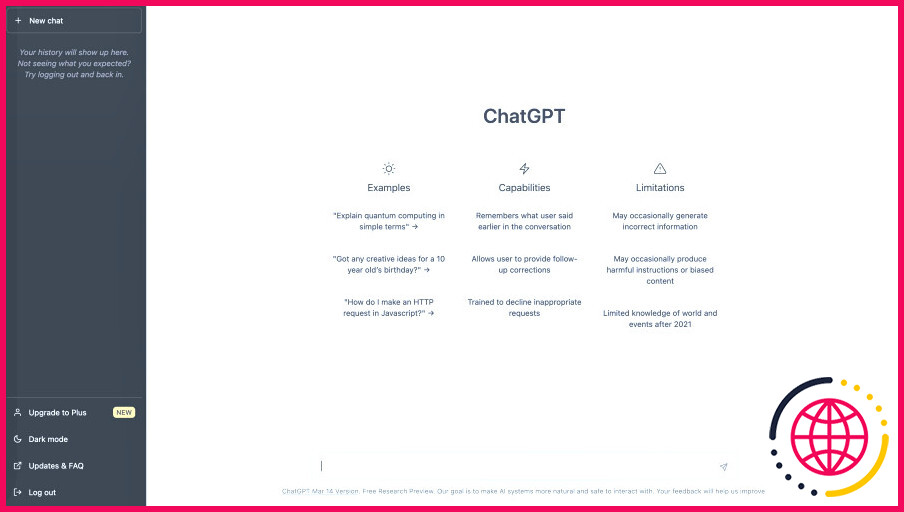

Qu’est-ce que ChatGPT ?

ChatGPT est un grand modèle linguistique conçu pour produire du langage humain naturel. Comme lors d’une conversation avec quelqu’un, vous pouvez parler à ChatGPT et il se souviendra de ce que vous avez dit dans le passé, tout en étant capable de se corriger lui-même en cas de doute.

Il a été entraîné sur toutes sortes de textes provenant d’Internet, comme Wikipedia, des articles de blog, des livres et des articles académiques. Cela signifie qu’en plus de vous répondre de manière humaine, il peut se souvenir d’informations sur notre monde actuel et retrouver des informations historiques de notre passé.

L’apprentissage de l’utilisation de ChatGPT est simple et il est facile de penser que le système d’IA fonctionne sans problème. Cependant, dans les mois qui ont suivi sa sortie, des personnes du monde entier ont poussé le chatbot IA jusqu’à ses limites, révélant ainsi quelques problèmes majeurs.

1. ChatGPT génère de mauvaises réponses

Il échoue en mathématiques de base, ne semble pas pouvoir répondre à des questions de logique simple et va même jusqu’à avancer des faits complètement erronés. Comme en témoignent les internautes sur les réseaux sociaux, ChatGPT peut se tromper plus d’une fois.

OpenAI est conscient de cette limitation, écrivant que : « ChatGPT écrit parfois des réponses à l’apparence plausible mais incorrectes ou absurdes. » Cette « hallucination » des faits et de la fiction, comme on l’a appelée, est particulièrement dangereuse lorsqu’il s’agit de conseils médicaux ou d’informations sur des événements historiques importants.

Contrairement à d’autres assistants d’IA comme Siri ou Alexa, ChatGPT n’utilise pas Internet pour trouver des réponses. Au lieu de cela, il construit une phrase mot par mot, en sélectionnant le « jeton » le plus probable qui devrait suivre, sur la base de sa formation. En d’autres termes, ChatGPT parvient à une réponse en faisant une série de suppositions, ce qui explique en partie pourquoi il peut argumenter des réponses erronées comme si elles étaient tout à fait vraies.

Bien qu’il soit excellent pour expliquer des concepts complexes, ce qui en fait un outil d’apprentissage puissant, il est important de ne pas croire tout ce qu’il dit. ChatGPT n’a pas toujours raison, du moins pas encore.

2. ChatGPT a des préjugés intégrés dans son système

ChatGPT a été formé sur la base des écrits collectifs des humains du monde entier, passés et présents. Malheureusement, cela signifie que les mêmes biais qui existent dans le monde réel peuvent également apparaître dans le modèle.

Il a été démontré que ChatGPT produit des réponses terribles qui sont discriminatoires à l’égard du sexe, de la race et des groupes minoritaires, ce que l’entreprise s’efforce d’atténuer.

Une façon d’expliquer ce problème est de pointer les données comme étant le problème, en blâmant l’humanité pour les préjugés qui sont ancrés sur Internet et au-delà. Mais une partie de la responsabilité incombe également à OpenAI, dont les chercheurs et les développeurs sélectionnent les données utilisées pour former ChatGPT.

Une fois de plus, OpenAI sait qu’il s’agit d’un problème et a déclaré qu’elle s’attaque à ce qu’elle appelle le « comportement biaisé » en recueillant les commentaires des utilisateurs qui sont encouragés à signaler les résultats de ChatGPT qui sont mauvais.

Compte tenu du potentiel de nuisance de ChatGPT, on peut penser qu’il n’aurait pas dû être mis à la disposition du public avant que ces problèmes ne soient étudiés et résolus. Mais une course pour être la première entreprise à publier les outils d’IA les plus puissants pourrait suffire à OpenAI pour jeter la prudence aux oubliettes.

En revanche, un chatbot d’IA similaire appelé Sparrow – appartenant à Alphabet, la société mère de Google – a été lancé en septembre 2022. Cependant, il a été volontairement gardé derrière des portes closes en raison de préoccupations similaires en matière de sécurité.

À peu près à la même époque, Facebook a publié un modèle de langage d’IA appelé Galactica, destiné à aider la recherche universitaire. Il a été rapidement rappelé après que de nombreuses personnes l’ont critiqué pour avoir produit des résultats erronés et biaisés liés à la recherche scientifique.

3. ChatGPT pourrait prendre des emplois aux humains

La poussière n’est pas encore retombée après le développement et le déploiement rapides de ChatGPT et la technologie sous-jacente est déjà intégrée dans un certain nombre d’applications commerciales. Parmi les applications qui ont intégré GPT-4, on trouve Duolingo et Khan Academy.

La première est une application d’apprentissage des langues, tandis que la seconde est un outil d’apprentissage éducatif diversifié. Toutes deux proposent ce qui est essentiellement un tuteur d’IA, soit sous la forme d’un personnage doté d’IA avec lequel vous pouvez parler dans la langue que vous apprenez, soit sous la forme d’un tuteur d’IA qui peut vous aider à comprendre la langue que vous apprenez. Ou sous la forme d’un tuteur IA qui peut vous donner un retour personnalisé sur votre apprentissage.

D’un côté, cela pourrait changer notre façon d’apprendre, en rendant l’éducation plus accessible et le processus d’apprentissage un peu plus facile. Mais l’inconvénient, c’est que cela supprime des emplois qui ont été occupés par des humains pendant longtemps.

Les progrès technologiques ont toujours entraîné des suppressions d’emplois, mais la rapidité des progrès de l’IA signifie que de nombreuses industries sont confrontées au même problème. De l’éducation à l’illustration en passant par le service à la clientèle, ChatGPT et sa technologie sous-jacente vont remodeler radicalement notre monde moderne.

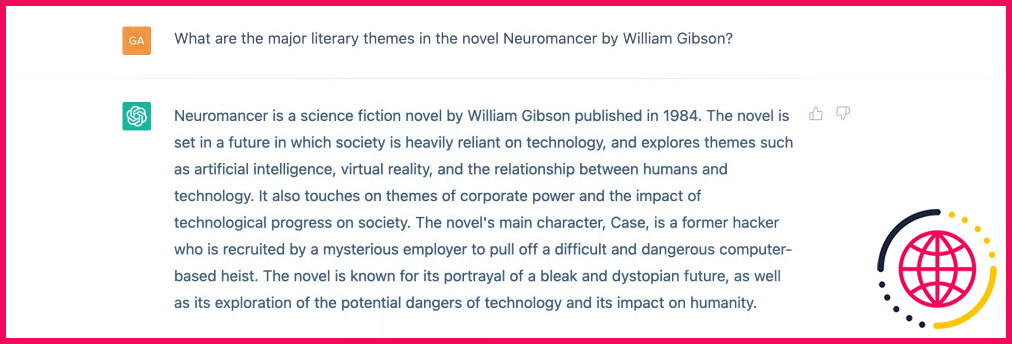

4. ChatGPT : un défi pour l’anglais au lycée

Vous pouvez demander à ChatGPT de relire votre texte ou de vous indiquer comment améliorer un paragraphe. Vous pouvez aussi vous retirer complètement de l’équation et demander à ChatGPT de faire tout le travail d’écriture à votre place.

Des enseignants ont expérimenté l’envoi de devoirs d’anglais à ChatGPT et ont reçu des réponses meilleures que ce que beaucoup de leurs élèves pouvaient faire. De la rédaction de lettres de motivation à la description des principaux thèmes d’une œuvre littéraire célèbre, ChatGPT peut tout faire sans hésitation.

Cela soulève la question suivante : si ChatGPT peut écrire pour nous, les étudiants auront-ils besoin d’apprendre à écrire à l’avenir ? Cela peut sembler être une question existentielle, mais lorsque les étudiants commenceront à utiliser ChatGPT pour les aider à rédiger leurs essais, les écoles devront rapidement trouver une réponse. Le déploiement rapide de l’IA ces dernières années devrait bouleverser de nombreuses industries, et l’éducation n’est que l’une d’entre elles.

5. ChatGPT pourrait causer des dommages dans le monde réel

Nous avons mentionné plus haut que des informations incorrectes fournies par ChatGPT peuvent causer des dommages dans le monde réel, par exemple des conseils médicaux erronés. Mais d’autres problèmes se posent également.

La vitesse à laquelle un texte à consonance naturelle peut être généré facilite la tâche des escrocs qui se font passer pour une personne que vous connaissez sur les médias sociaux. De même, le repérage d’un courriel d’hameçonnage destiné à vous soutirer des informations sensibles est simplifié, avec l’avantage supplémentaire que ChatGPT peut produire un texte exempt de fautes de grammaire, ce qui constituait auparavant un signal d’alarme évident.

La diffusion de fausses informations est également un problème sérieux. L’échelle à laquelle ChatGPT peut produire du texte, associée à la capacité de faire passer même des informations incorrectes pour des informations correctes, va certainement rendre l’information sur l’internet encore plus douteuse.

La vitesse à laquelle ChatGPT peut produire des informations a déjà causé des problèmes à Stack Exchange, un site web dont l’objectif est de fournir des réponses correctes aux questions de tous les jours. Peu après la sortie de ChatGPT, les utilisateurs ont commencé à inonder le site avec des réponses qu’ils demandaient à ChatGPT de générer.

En l’absence d’un nombre suffisant de volontaires humains pour trier les réponses, il aurait été impossible de maintenir un niveau élevé de qualité des réponses. De plus, de nombreuses réponses n’étaient tout simplement pas correctes. Pour éviter que le site web ne soit endommagé, toutes les réponses générées par ChatGPT ont été interdites.

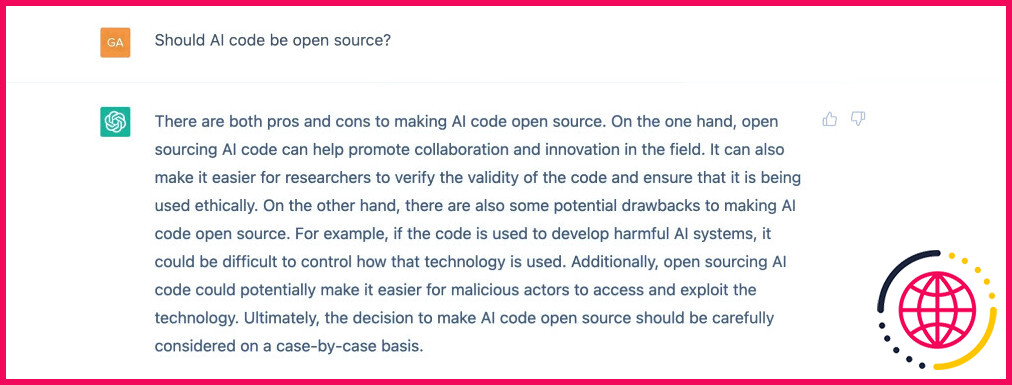

6. OpenAI détient tout le pouvoir

Un grand pouvoir implique de grandes responsabilités, et OpenAI détient beaucoup de pouvoir. C’est l’une des premières entreprises d’IA à avoir véritablement bouleversé le monde avec non pas un, mais plusieurs modèles d’IA générative, dont Dall-E 2, GPT-3 et GPT-4.

OpenAI choisit les données utilisées pour former ChatGPT, mais cette information n’est pas accessible au public. Nous ne connaissons tout simplement pas les détails de la formation de ChatGPT, les données utilisées, leur provenance ou l’architecture détaillée du système.

Alors que l’OpenAI considère la sécurité comme une priorité absolue, nous ignorons beaucoup de choses sur le fonctionnement des modèles eux-mêmes, pour le meilleur ou pour le pire. Que vous pensiez que le code devrait être rendu open source, ou que vous soyez d’accord pour en garder certaines parties secrètes, il n’y a pas grand-chose que nous puissions faire à ce sujet.

En fin de compte, nous devons faire aveuglément confiance à OpenAI pour la recherche, le développement et l’utilisation de ChatGPT de manière responsable. Que nous soyons d’accord ou non avec les méthodes, OpenAI continuera à développer ChatGPT en fonction de ses propres objectifs et normes éthiques.

S’attaquer aux plus grands problèmes de l’IA

Il y a beaucoup de raisons de s’enthousiasmer pour ChatGPT, mais au-delà de ses utilisations immédiates, il y a de sérieux problèmes qui méritent d’être compris. OpenAI admet que ChatGPT peut produire des réponses nuisibles et biaisées, et espère atténuer le problème en recueillant les commentaires des utilisateurs. Mais sa capacité à produire des textes convaincants, même lorsque les faits ne sont pas vrais, peut facilement être utilisée par des personnes mal intentionnées.

Avec les nouvelles technologies, il est difficile de prévoir les problèmes qui se poseront à l’avenir. Par conséquent, même s’il est amusant de l’utiliser, il ne faut pas croire tout ce que ChatGPT a à dire.

S’abonner à notre lettre d’information

Quels sont les problèmes avec ChatGPT ?

En résumé, l’utilisation de ChatGPT soulève des questions juridiques et éthiques liées aux droits d’auteur, à la protection de la vie privée, à l’utilisation abusive, à la partialité et à la transparence. Il est important que les utilisateurs soient conscients de ces problèmes et prennent des mesures pour les atténuer.

Quelles sont les limites de ChatGPT ?

11 Limites de ChatGPT [with examples]. Il ne peut pas accéder à l’internet. Il peut produire des données non sensées. Ses connaissances sont limitées. Il ne fournit pas d’informations approfondies. Il manque d’expressions. Il ne peut pas résoudre des questions mathématiques complexes avec précision. Il n’accepte que des données sous forme de texte.

- Il ne peut pas accéder à l’internet.

- Il peut produire des données absurdes.

- Ses connaissances sont limitées.

- Il ne fournit pas d’informations approfondies.

- Il manque d’expressions.

- Il ne peut pas résoudre des questions mathématiques complexes avec précision.

- Il n’accepte que des entrées sous forme de texte.

Quel est l’impact négatif de ChatGPT ?

Les conversations produites par ChatGPT risquent d’être trop simplistes, voire inexactes = les préjugés ou la discrimination sont introduits dans la « conversation ». Cela pourrait conduire les gens à se sentir traités avec condescendance ou incompris par la technologie, ce qui irait à l’encontre des efforts de la DEIB.

Quelles sont les limites du chatbot OpenAI ?

Le programme a ses limites, notamment une base de connaissances qui se termine en 2021, une tendance à produire des réponses incorrectes, à utiliser constamment les mêmes phrases et, lorsqu’on lui donne une version d’une question, le bot affirme qu’il ne peut pas y répondre, mais lorsqu’on lui donne une version légèrement modifiée, il y répond très bien.