Ici's Ma liste de fonctionnalités rêvées pour l’Apple Intelligence

Je suis très enthousiaste à l’idée de la sortie d’Apple Intelligence, mais je pense qu’il y a encore beaucoup de place pour l’amélioration. Apple pourrait ajouter plusieurs fonctionnalités pour l’améliorer encore. Voici mes idées sur ce qui pourrait faire passer la suite de fonctions d’IA d’Apple au niveau supérieur.

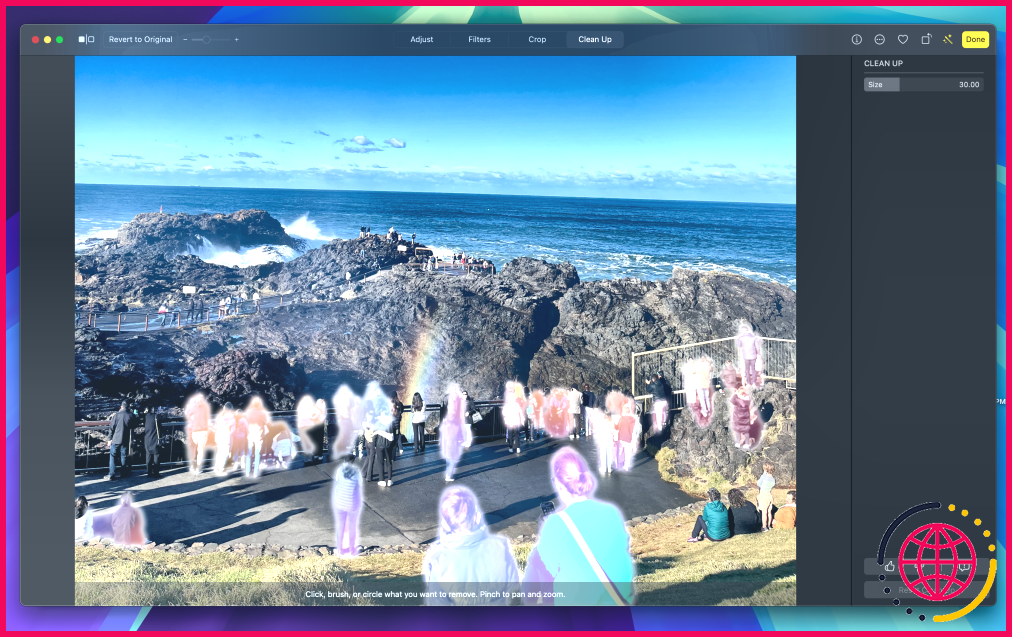

1 Plus d’outils de retouche d’images

Apple Intelligence ne propose qu’une seule grande fonctionnalité d’édition d’images appelée Clean Up, similaire à la gomme magique de Google, qui permet de supprimer les objets indésirables des photos. Bien qu’il s’agisse d’un ajout bienvenu, il ne semble pas révolutionnaire, d’autant plus que Google et Samsung proposent des outils similaires depuis un certain temps déjà.

Au-delà de Clean Up, Apple Intelligence offre très peu d’outils de retouche photo. En revanche, le Google Pixel 9 dispose de nombreuses fonctionnalités IA étonnantes, comme Add Me, qui permet de s’assurer que tout le monde est inclus dans les photos de groupe, ou Reimagine, qui vous permet de remplacer des parties d’une image simplement en la décrivant à l’aide d’une invite textuelle. Il serait formidable qu’Apple s’inspire de Google et introduise des fonctionnalités similaires.

N’étant pas très doué pour l’édition de photos, j’aimerais beaucoup une fonction qui me permette de générer des filtres à partir d’un texte. Je pourrais décrire les couleurs que je veux faire ressortir davantage ou le type d’ambiance que je souhaite obtenir, et le modèle d’IA créerait un filtre correspondant à cette description.

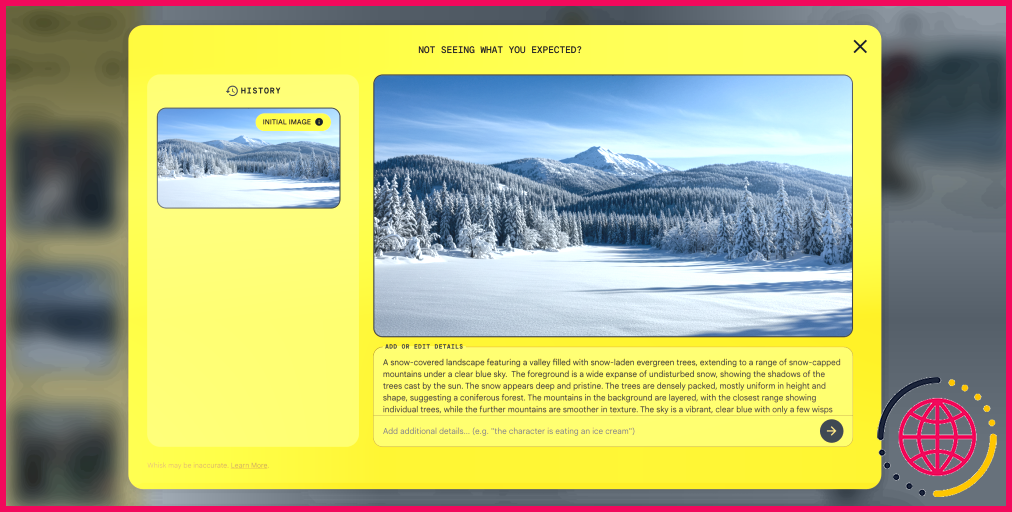

2 Génération d’images plus réalistes

Apple a également présenté une nouvelle application appelée Image Playground dans le cadre d’Apple Intelligence, permettant aux utilisateurs de générer des images à partir d’une invite textuelle dans trois styles artistiques différents : Animation, Illustration et Esquisse. Cette application s’intègre parfaitement à des applications telles que Messages et même à des plateformes tierces. Bien que la mise en œuvre soit bien faite, je ne suis pas fan des résultats.

Les styles artistiques sont trop caricaturaux à mon goût, et je ne me vois pas utiliser Image Playground pour créer des images et les envoyer à des amis ou à la famille. Bien que le modèle fonctionne bien pour Genmojis, qui vous permet de créer des emojis personnalisés entièrement nouveaux à l’aide d’une invite textuelle, il devrait y avoir des styles artistiques plus réalistes disponibles.

L’une des raisons possibles est que le modèle de diffusion d’images fonctionne sur l’appareil pour une meilleure confidentialité. Cependant, je ne serais pas contre un modèle de génération d’images plus réaliste qui s’exécute sur le Cloud Compute privé d’Apple pour gérer les demandes de calcul plus élevées, qui supprime également toutes vos données après avoir traité vos demandes.

3 Filtrage des appels

L’une de mes fonctionnalités préférées sur le Google Pixel est le filtrage des appels, où Google Assistant répond aux appels pour vous et fournit une transcription en direct, vous aidant à décider si vous prenez l’appel. Il peut même décrocher les appels de numéros inconnus pour vous, et s’il détecte qu’il s’agit d’un robocall ou d’un appel de spam, Google Assistant raccrochera automatiquement l’appel sans jamais vous déranger.

Il serait formidable que Siri puisse faire quelque chose de similaire et générer des réponses automatiques basées sur le contexte. Par exemple, si votre iPhone sait que vous êtes absent, Siri pourrait automatiquement demander à un livreur de laisser le colis à votre porte.

Malheureusement, Apple Intelligence se limite actuellement à générer une transcription et à fournir un résumé d’un appel téléphonique, mais c’est un domaine qu’Apple devrait envisager d’étendre.

4 De meilleures fonctionnalités de traduction en direct

Bien que vous puissiez utiliser l’application Translate intégrée pour des tâches de base, comme taper un texte et le faire lire à haute voix dans une autre langue, je ne peux m’empêcher de penser que l’intelligence d’Apple pourrait apporter beaucoup plus.

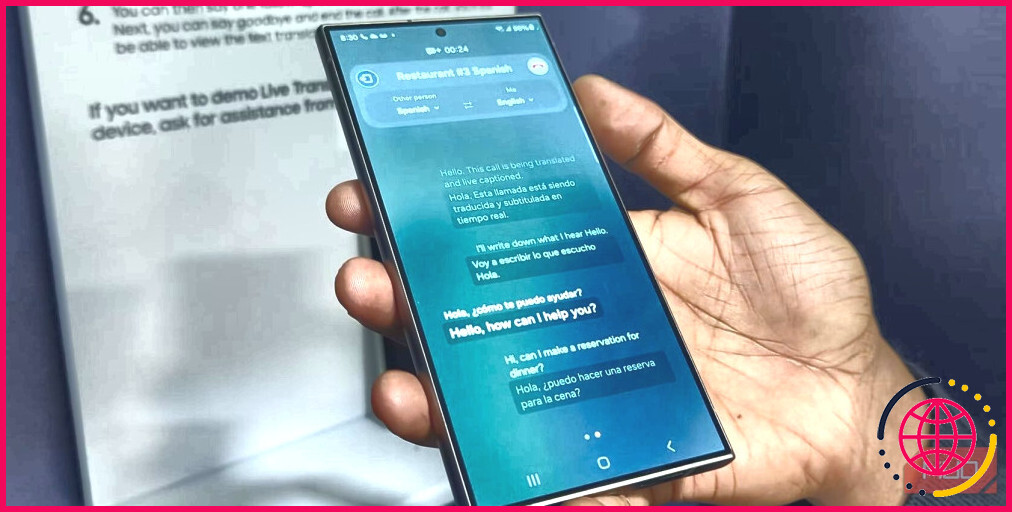

Ce que j’aimerais vraiment voir, ce sont des outils de traduction en temps réel qui fonctionnent à l’échelle du système. Un bon exemple est Live Translate de Samsung, qui peut transcrire et traduire des conversations en temps réel pendant les appels téléphoniques. Google propose également des fonctions similaires qui fonctionnent de manière transparente dans plusieurs applications, tout le traitement se faisant sur l’appareil.

Étant donné que Samsung et Google ont déjà mis en œuvre ces fonctionnalités et que leurs modèles fonctionnent efficacement sur l’appareil, je ne vois pas pourquoi Apple n’a pas mis l’accent sur les fonctionnalités de traduction avec Apple Intelligence.

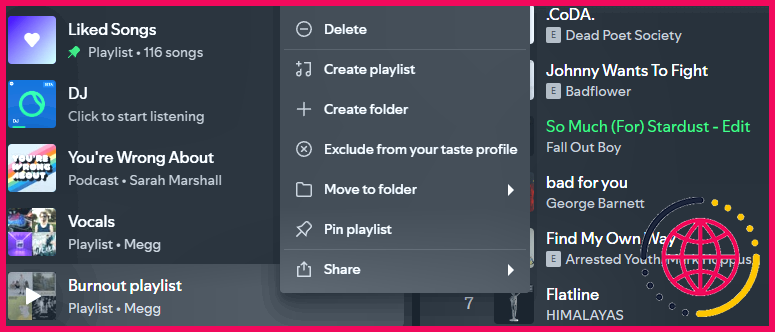

5 La possibilité de choisir votre LLM tiers

Bien que Siri bénéficie d’une mise à jour majeure avec des fonctionnalités telles que la sensibilisation à l’écran, il se peut qu’il ne réponde pas à toutes les demandes. Pour combler ces lacunes, il utilise ChatGPT comme solution de repli pour générer des réponses ou répondre à des questions concernant des photos ou des documents.

Bien que ChatGPT soit excellent, j’aimerais pouvoir choisir le LLM tiers que je souhaite utiliser, un peu comme vous pouvez changer votre moteur de recherche par défaut. Nous avons déjà vu des alternatives à ChatGPT qui excellent dans des tâches spécifiques. Ce serait encore mieux si les utilisateurs pouvaient définir des préférences pour différentes tâches ; par exemple, utiliser automatiquement Claude pour les questions relatives aux images et passer à Gemini ou ChatGPT pour la génération de texte.

Voilà donc les fonctionnalités que j’aimerais voir dans Apple Intelligence. Cela dit, il y a encore beaucoup à attendre pour voir comment la suite d’IA d’Apple se situe par rapport aux offres de Google et de Samsung. Bien qu’elle ne soit pas disponible publiquement, vous pouvez essayer Apple Intelligence dans les bêtas d’iOS 18.1 et de macOS 15.1. N’oubliez pas que votre expérience ne sera peut-être pas tout à fait stable, car il s’agit encore de premières versions expérimentales.

Quelles sont les fonctionnalités d’Apple Intelligence disponibles ?

Les fonctionnalités de l’Apple Intelligence expliquées – tout ce que vous devez savoir sur l’Apple AI et quand vous pouvez l’utiliser. Accédez à Apple Intelligence.Outils de rédaction.Résumés.Refonte de Siri.Améliorations de Photos.Mail.Synthèse vocale.Intelligence visuelle.

- Accédez à Apple Intelligence.

- Outils d’écriture.

- Résumés.

- Refonte de Siri.

- Amélioration des photos.

- Courrier.

- Conversion de la parole en texte.

- Intelligence visuelle.

Quel est un exemple d’Apple Intelligence ?

Concevez des images originales avec Image Playground Décrivez simplement ce que vous voulez, et Apple Intelligence le créera pour vous. Par exemple, vous pouvez créer une image de votre produit utilisé dans un lieu exotique ou visualiser un ensemble de données complexes sous la forme d’une infographie, le tout sans quitter votre iPhone.

Quelles sont les conditions requises pour utiliser Apple Intelligence ?

Configuration requise pour Apple Intelligence sur iPhone. iPhone 16, iPhone 16 Plus, iPhone 16 Pro, iPhone 16 Pro Max, iPhone 15 Pro ou iPhone 15 Pro Max.iOS 18.1.Langue de l’appareil et langue Siri réglées sur une langue prise en charge.4 Go de stockage sur l’iPhone*.

- iPhone 16, iPhone 16 Plus, iPhone 16 Pro, iPhone 16 Pro Max, iPhone 15 Pro ou iPhone 15 Pro Max.

- iOS 18.1.

- Langue de l’appareil et langue Siri réglées sur une langue prise en charge.

- 4 Go de stockage sur l’iPhone*

Qu’est-ce que la nouvelle intelligence d’Apple ?

L’Apple Intelligence de la gamme iPhone 16 exploite la puissance du silicium Apple et des modèles génératifs conçus par Apple pour comprendre et créer du langage et des images, agir dans les apps et puiser dans le contexte personnel pour simplifier et accélérer les tâches quotidiennes.